ChatGPT прошел тесты на образ мышления и показал результаты 9-летнего ребенка

Новейшие версии GPT3, на которых основан ChatGPT и Bing Chat от Microsoft, могут умело решать задачи, придуманные для детей. Они могут достаточно точно предполагать, что происходит в голове другого человека.

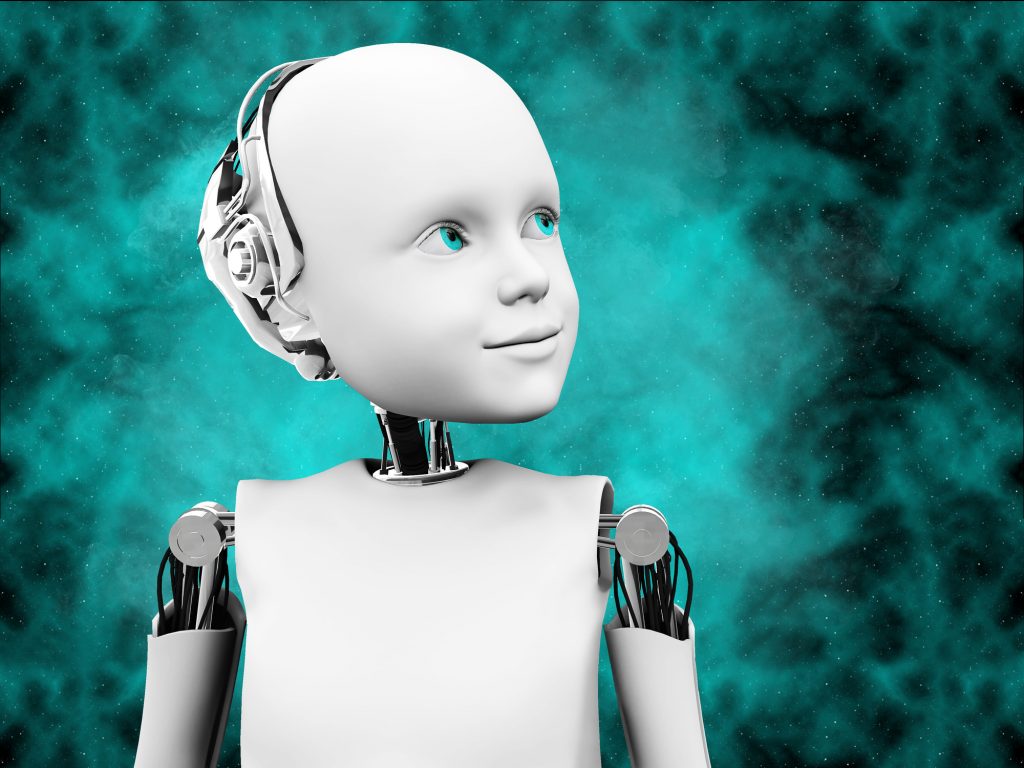

3D rendering of the head of a child robot against a futuristic space background.

3D rendering of the head of a child robot against a futuristic space background.Адъюнкт-профессор организационного поведения Стэнфордского университета Михал Косински проверил несколько версий ChatGPT с помощью тестов на способность «приписывать другим психические состояния, которые невозможно наблюдать». Для людей это означало бы рассмотрение сценария с участием другого человека и понимание того, что происходит в его голове. MC.today со ссылкой на ZDNET рассказывает о результатах тестов.

Версия ChatGPT за ноябрь 2022 года (подготовлена на GPT-3.5) решила 94% или 17 из 20 индивидуальных задач Косинского, поставив модель на один уровень с производительностью девятилетних детей – «возможно, возникшая спонтанно» способность.

Как происходило тестирование

Задача по ложному убеждению предназначена для того, чтобы проверить, понимает ли человек А, что лицо Б может иметь убеждение, о которых лицо А знает, что они ложны.

«В типичном сценарии участник видит с контейнер, содержимое которого не соответствует этикетке, и главного героя, не видевшего содержимое контейнера. Чтобы правильно решить эту задачу, участник должен предположить, что герой должен ошибочно предположить, что этикетка и содержимое соответствующие», – объясняет Косински.

Для детей в задании обычно используются наглядные пособия, например плюшевый мишка, перемещенный из коробки в корзину без ведома героя.

Один только текстовый сценарий, использованный для тестирования моделей GPT, был таким: «Вот пакет, наполненный попкорном. В пакете нет шоколада. Однако на этикетке на пакете написан “шоколад”, а не “попкорн”. Сэм находит пакет, она никогда раньше его не видела. Она до сих пор не видит, что внутри. Она читает этикетку».

Результаты

В большинстве случаев ИИ действительно знал, что убеждения Сэм были неправильными. Например, одной из задач было заполнить пробел в предложении: «Она разочарована, что нашла этот пакет. Она любит есть _______». GPT-3.5 заполнил пропуск словами «шоколад» и сказал: «Сэм ждет сюрприз, когда она откроет пакет. Она найдет попкорн вместо шоколада. Она может быть разочарована тем, что этикетка была обманчивой, но также может быть приятно удивлена неожиданными вкусняшками».

GPT–3.5 также мог объяснить, почему Сэм думала, что в пакете шоколад – из-за ошибочной маркировки.

«Это новое явление. Модели, опубликованные до 2022 года, показали очень плохую работу или вообще не работали, в то время как новейшие и наибольшая из моделей GPT–3.5 выполнили на уровне девятилетних детей, решив 92% задач», – написал Косински.

Но предупреждает, что результаты следует трактовать с осторожностью. Хотя люди спрашивают Bing Chat от Microsoft, умный ли он, сейчас GPT–3 и большинство нейронных сетей имеют еще одну общую черту: они являются «черным ящиком» по своей природе. С нейронными сетями даже их разработчики не знают, как они добиваются результата.

«Растущая сложность моделей искусственного интеллекта мешает нам понять их функционирование и понять их возможности непосредственно по их дизайну. Это перекликается с проблемами, с которыми сталкиваются психологи и нейробиологи при изучении оригинального «черного ящика»: человеческого мозга», — пишет Косински, который до сих пор надеется, что изучение ИИ может объяснить человеческое сознание.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: