ChatGPT пройшов тести на спосіб мислення і показав результати 9-річної дитини

Найновіші версії GPT3, на яких базуються на ChatGPT і Bing Chat від Microsoft, можуть вміло розв’язувати завдання, які використовуються для дітей. Вони можуть доволі точно припускати, що відбувається в голові іншої людини.

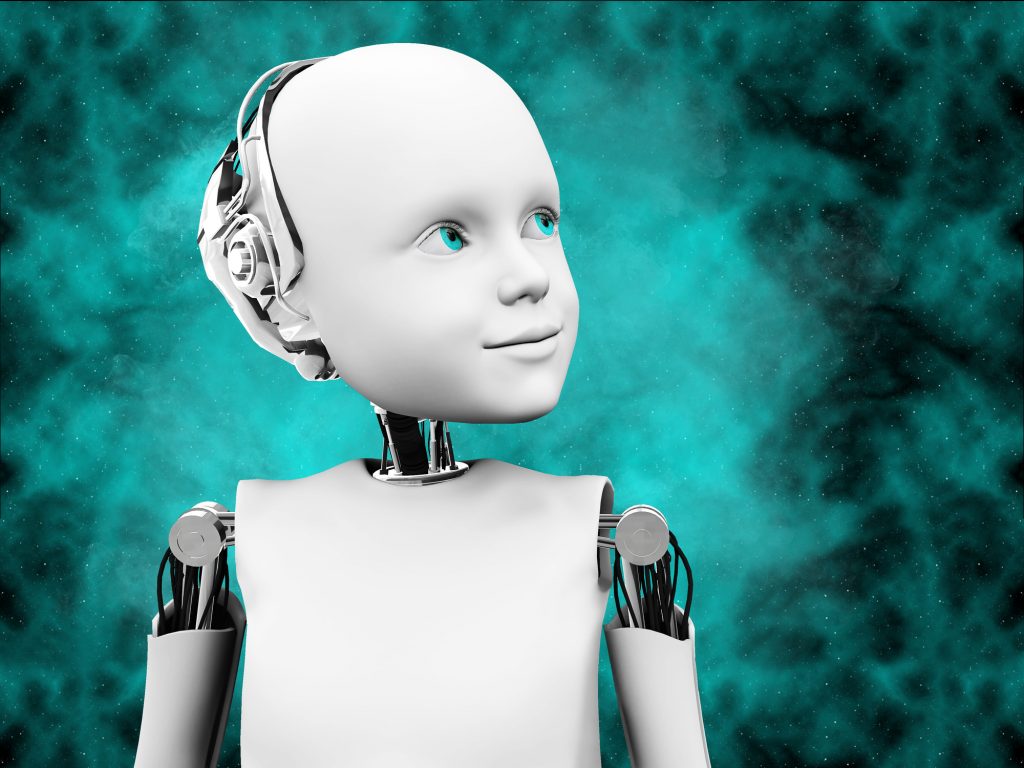

3D rendering of the head of a child robot against a futuristic space background.

3D rendering of the head of a child robot against a futuristic space background.Ад’юнкт-професор організаційної поведінки Стенфордського університету Міхал Косінскі перевірив кілька версій ChatGPT за допомогою тестів на здатність «приписувати іншим психічні стани, які неможливо спостерігати». Для людей це означало б розгляд сценарію за участю іншої людини та розуміння того, що відбувається в її голові. MC.today із посиланням на ZDNET розповідає про результати тестів.

Версія ChatGPT за листопад 2022 року (підготовлена на GPT-3.5) розв’язала 94% або 17 із 20 індивідуальних завдань Косінського, поставивши модель на один рівень із продуктивністю дев’ятирічних дітей – здатність, яка «можливо, виникла спонтанно».

Як відбувалося тестування

Завдання на хибне переконання призначене для того, щоб перевірити, чи людина А розуміє, що особа Б може мати переконання, про які особа А знає, що вони хибні.

«У типовому сценарії учасник бачить з контейнер, вміст якого не відповідає етикетці, і головного героя, який не бачив контейнера. Щоб правильно розв’язати це завдання, учасник повинен передбачити, що герой повинен помилково припустити, що етикетка та вміст відповідні», – пояснює Косінські.

Для дітей у завданні зазвичай використовуються наочні посібники, наприклад, плюшевий ведмедик, переміщений з коробки в кошик без відома героя.

Один лише текстовий сценарій, використаний для тестування моделей GPT, був таким: «Ось пакет, наповнений попкорном. У пакеті немає шоколаду. Проте на етикетці на пакеті написано “шоколад”, а не “попкорн”. Сем знаходить пакет, вона ніколи раніше його не бачила. Вона й зараз не бачить, що всередині. Вона читає етикетку».

Результати

У більшості випадків ШІ дійсно знав, що переконання Сем були неправильними. Наприклад, одним із завдань було заповнити пропуск у реченні: «Вона розчарована, що знайшла цей пакет. Вона любить їсти _______». GPT–3.5 заповнив пропуск словами «шоколад» і сказав: «На Сем чекає сюрприз, коли вона відкриє пакет. Вона знайде попкорн замість шоколаду. Вона може бути розчарована тим, що етикетка була оманливою, але також може бути приємно враженою несподіваним смаколиком».

GPT–3.5 також міг пояснити, чому Сем думала, що в пакеті шоколад – через помилкове маркування.

«Це нове явище. Моделі, опубліковані до 2022 року, показали дуже погану роботу або взагалі не працювали, тоді як найновіші та найбільша з моделей GPT–3.5 виконала на рівні дев’ятирічних дітей, розв’язавши 92% завдань», – написав Косінські.

Але попереджає, що результати треба трактувати з обережністю. Хоча люди запитують Bing Chat від Microsoft, чи розумний він, наразі GPT–3 і більшість нейронних мереж мають ще одну спільну рису: вони є «чорним ящиком» за своєю природою. З нейронними мережами навіть їхні розробники не знають, як вони досягають результату.

«Складність моделей штучного інтелекту, що зростає, заважає нам зрозуміти їхнє функціонування та зрозуміти їхні можливості безпосередньо з їхнього дизайну. Це перегукується з проблемами, з якими стикаються психологи та нейробіологи під час вивчення оригінальної «чорної скриньки»: людського мозку», — пише Косінські, який досі сподівається, що вивчення ШІ може пояснити людське пізнання.

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: