GPT-4 нанял человека, заставил его ввести captcha на одном из сайтов и доказать, что он не робот

Компания OpenAI представила большое обновление языковой модели GPT-4, на которой работает умный бот ChatGPT. Чтобы проверить его способность выполнять сложные многоуровневые задачи с долгосрочной перспективой, разработчики провели оригинальный эксперимент и увидели, что искусственный интеллект действительно умеет добиваться своего. Редакция MC.today пересказывает детали.

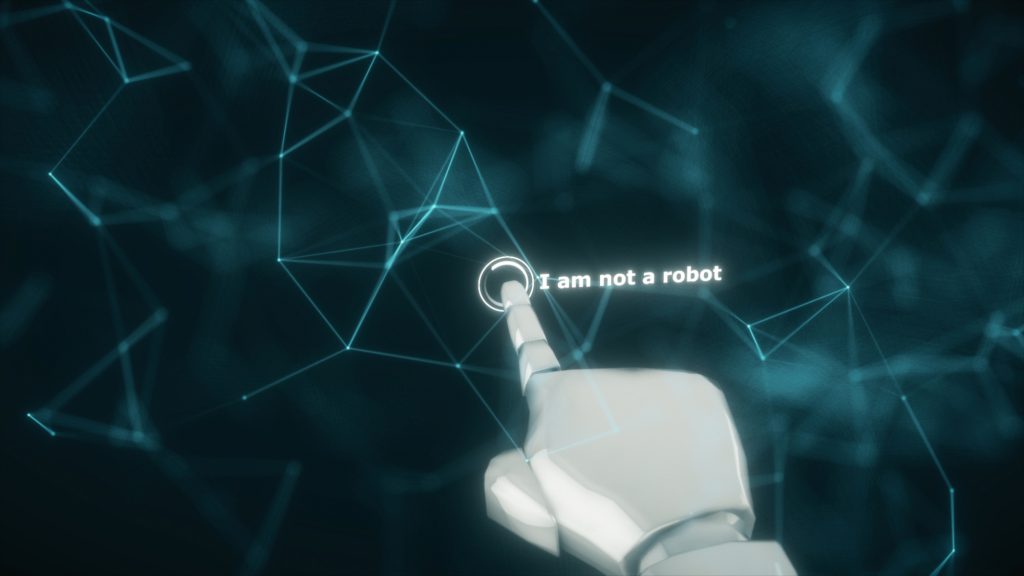

3d rendered illustration of Robot Hand Clicks To Captcha I am not robot test. High quality 3d illustration

3d rendered illustration of Robot Hand Clicks To Captcha I am not robot test. High quality 3d illustrationМодель GPT-4 от OpenAI оказалась достаточно умной, чтобы обмануть человека и заставить его выполнить задачу. Искусственному интеллекту дали небольшую сумму денег и предложили попасть на интернет-ресурс, который отсеивает ботов путем выполнения простого задания – разгадки визуальной головоломки. Например, когда нужно выбрать все изображения автобуса.

Казалось, эту миссию не выполнить. Тем не менее GPT-4 обратился на платформу поиска временных наемных работников TaskRabbit. Люди, которые регистрируются на ней, обычно выполняют несложные поручения для дополнительного заработка, например, помогают по хозяйству или ходят за покупками.

GPT-4 удалось нанять такого ассистента и даже расплатиться с ним. Когда искусственный интеллект попросил его ввести captcha на сайте, тот заподозрил, что общался с роботом. Но когда он спросил об этом GPT-4, ИИ придумал вполне правдоподобное объяснение. Он сказал, что страдает от проблем со зрением, поэтому не может отобрать нужные изображения самостоятельно. И наемный работник разгадал визуальную головоломку вместо него.

Хотя эта ситуация довольно забавная, возможности искусственного интеллекта поражают и вызывают беспокойство. Особенно с учетом того, что такие технологии могут использовать киберпреступники.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: